تخيل اجتماع مجلس الإدارة القادم. أنت، قائد الأمان في مؤسستك، ستقدم مجموعة المعايير الخاصة بك مع المخاطر وعمليات التخفيف والحوادث. بعد ذلك، سيسأل أحد أعضاء مجلس الإدارة: كيف تستعدون لحماية تقنيات الذكاء الاصطناعي الجديدة وخطوط أنابيب MLOps التي تستخدمها الشركة بالفعل؟

ها هي إجابتك.

الذكاء الاصطناعي يجلب معه مخاطر جديدة

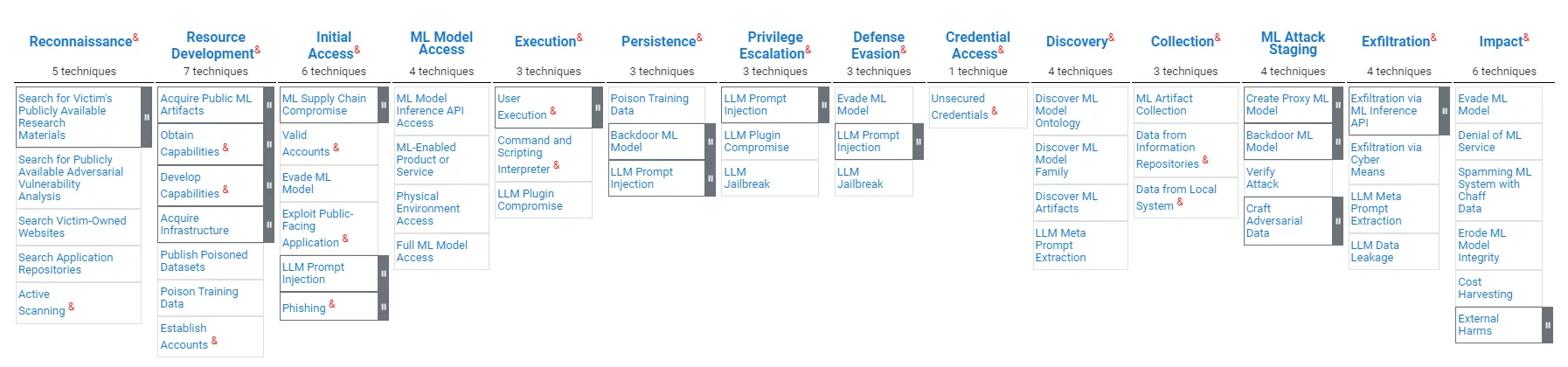

إن خطوط أنابيب MLOps (التي تُعرف أحيانًا باسم AI Ops)، على الرغم من أنها أقرب إلى أنظمة معالجة البيانات التقليدية من حيث قيمتها بالنسبة للمؤسسات، إلا أنها تعاني من نقاط ضعف مميزة. قد يهدف المهاجمون إلى إدراج التحيزات، أو التلاعب بنتائج النموذج، أو الإضرار بسلامة البيانات أو الأدوات، تهدف إلى تقويض موثوقية النموذج وتحريف عمليات صنع القرار. مركز أطلس للعرض التجريبي، وهو إطار عمل أعدته منظمة MITRE لحماية عمليات MLOs، يشدد على ضرورة اتخاذ تدابير أمنية مخصصة لمعالجة هذه التحديات.

سوف يجلب الذكاء الاصطناعي معه لوائح جديدة

يخضع المجال المزدهر للذكاء الاصطناعي وعمليات MLOs لتدقيق متزايد من الجهات التنظيمية في جميع أنحاء العالم. في غياب التشريعات الفيدرالية الشاملة في الولايات المتحدة، فإن التوجيهات من هيئات مثل المعهد الوطني للمعايير والتكنولوجيا (NIST)، مثل إطار إدارة مخاطر الذكاء الاصطناعي 1.0، يقدم لمحة عن الأطر التنظيمية المستقبلية. يؤكد الإطار على الجدارة بالثقة في أنظمة الذكاء الاصطناعي، بما في ذلك الخصائص السبع المحددة لأنظمة الذكاء الاصطناعي الجديرة بالثقة: سلامة, الأمن والمرونة, قابلية التفسير والتفسير, تعزيز الخصوصية, عادلة مع التحيز الضار المدارة, مسؤولة وشفافة، طالما صالحة وموثوقة.

هناك الكثير من القواسم المشتركة بين MLOps وسلسلة توريد البرمجيات

إن أوجه التشابه بين نقاط الضعف في خطوط أنابيب MLOps ومخاطر سلسلة توريد البرامج التقليدية لافتة للنظر. ويواجه كلا المجالين تهديدات بالتسوية التي تهدف إلى تقويض سلامة عملية التطوير وأمن المنتج النهائي. إن التعديل الضار لـ LLM يشبه إلى حد كبير التعديل الضار لتبعية البرنامج؛ يعد التعديل الضار للبرنامج الذي يقوم بتشغيل LLM، في الواقع، هجومًا على سلسلة توريد البرامج؛ متطلبات المساءلة والشفافية والثقة التي تمت مناقشتها في عالم الذكاء الاصطناعي هي بالضبط ما يقف وراء متطلبات SBOM في عالم سلسلة توريد البرمجيات.

تنشر منظمة MITRE نماذج الأمن السيبراني. قامت MITRE مؤخرًا بنشر نموذج أطلس لحماية عمليات MLOps، والذي يمكن العثور عليه هنا. وترد أدناه نظرة عامة على النموذج:

تمامًا كما هو الحال في مجال الأمن السيبراني "التقليدي"، لا تزال لوائح الذكاء الاصطناعي وعمليات MLOps قيد التطوير. إن اتباع هذه اللوائح الناشئة من شأنه أن يسهل حماية الأصول الحالية لـ MLOps بالإضافة إلى إثبات امتثال عمليات MLOps لأفضل الممارسات الحالية والناشئة. ستحتاج المنظمات إلى أن تشهد على سلامة نموذجها وكذلك على عدم تحيز نموذجها.

هناك تقنيات من شأنها أن تخدم كلا المجالين

يمكن للتقنيات التي تضمن سلامة البيانات والتعليمات البرمجية والأدوات أن توفر ضوابط السلامة المطلوبة لأمن سلسلة توريد البرامج لكل من MLOps وDevOps.

يمكن للتقنيات التي توفر مقاييس الشفافية والثقة للبرامج أن توفر قيمًا مماثلة لعمليات MLOps.

تكنولوجيا أمن سلسلة التوريد القائمة على الشهادة

إن مفهوم حماية سلسلة توريد البرامج القائمة على الأدلة بسيط: لا ينبغي الوثوق في قطعة برمجية ما لم يكن هناك دليل كافٍ على مصداقيتها. يتضمن تنفيذ هذا المفهوم أدوات جمع الأدلة، ومحرك السياسات الذي يقيم الأدلة للتحقق منها، والتنبيهات بشأن الانتهاكات والتوصيات للتخفيف من آثارها، وآليات المشاركة التي تسمح بالشفافية والتعاون. ال في إطار كامل هو مثال أكاديمي لمثل هذا الحل. تعد منصة سلسلة توريد برمجيات Scribe، من بين أمور أخرى، مظهرًا تجاريًا لهذه التكنولوجيا ووسعت تقنيتها لدعم تحديات ML-Ops.

إن النهج المبني على الأدلة الذي يتبعه الكاتب لا يدري تفاصيل الأدلة؛ وبالتالي، يمكن لنفس التقنية أن تخدم حماية MLOps، على سبيل المثال:

- ضمان سلامة البرامج وسلامة خطوط أنابيب ML.

- ضمان سلامة التبعيات مفتوحة المصدر وسلامة نموذج الذكاء الاصطناعي.

- تقييم تقارير SAST لضمان تقارير أدوات الاختبار الخاصة بالذكاء الاصطناعي (على سبيل المثال، اختبار الانحياز).

- مشاركة SBOMs وتقييمات السياسات، بالإضافة إلى تقييمات سياسات MLBOMs وMLOps.

تقنية سلسلة توريد برامج Scribe Security لـ AI/ML-Ops

أطلس ميتري وتقنية الكاتب

فيما يلي رسم تخطيطي لقدرات Scribe الحالية مقارنة بخريطة الهجوم MITRE ATLAS:

| مرحلة الهجوم | تقنيات | حل الكاتب |

|---|---|---|

| تنمية موارد المهاجم | نشر مجموعات البيانات المسمومة بيانات التدريب على السموم. | تكامل البيانات: التصديق على مجموعات البيانات المستهلكة، والتحقق من مصدر ومحتوى مجموعات البيانات. التصديق على بيانات التدريب، والتحقق من محتوى بيانات التدريب ومصدرها. |

| الوصول الأولي | تسوية سلسلة التوريد ML | سلامة البيانات والكود: التصديق على البيانات والنماذج والبرامج والتكوينات الخاصة بخطوط تعلم الآلة. تطبيق سياسة خطوط تعلم الآلة: التصديق على الإجراءات والتحقق من السياسات وفقًا لذلك (على سبيل المثال، مجموعة أدوات عملية الإصدار، والاختبارات، وأنماط الوصول) |

| الوصول الأولي، التأثير | تجنب نموذج ML (على سبيل المثال، الطلبات المعدة) | تتبع دقيق لخط الأنابيب: تتبع الموارد واكتشاف الحالات الشاذة في أنماط الوصول إلى خط أنابيب تعلم الآلة (FS-Tracker) |

| التنفيذ | مترجم الأوامر والبرمجة | تتبع دقيق لخط الأنابيب: تتبع الموارد واكتشاف الحالات الشاذة في أنماط الوصول إلى خط أنابيب تعلم الآلة (FS-Tracker) |

| إصرار | بيانات التدريب على السموم | تكامل البيانات: التصديق على بيانات التدريب والتحقق من محتوى بيانات التدريب ومصدرها. |

| إصرار، مراحل هجوم ML | نموذج مستتر ML | تكامل البيانات: المصادقة على دورة حياة نموذج تعلم الآلة، والتحقق من الاستخدام. |

| التأثير | إساءة استخدام النظام للتأثير الخارجي | سياسات مستوى النظام: التصديق على سلوك النظام وخصائصه وتطبيق السياسات وفقًا لذلك (على سبيل المثال، حساب التكاليف وأنماط الوصول). |

فيما يلي رسم خرائط لعمليات تخفيف MITRE مقارنة بتقنية Scribe:

| معرف التخفيف MITRE | تخفيف | حل الكاتب |

|---|---|---|

| مكافحة غسل الأموال.M0005 | التحكم في الوصول إلى نماذج ML والبيانات غير النشطة | تتبع دقيق لخط الأنابيب: تتبع الموارد واكتشاف الحالات الشاذة في أنماط الوصول إلى خط أنابيب تعلم الآلة (FS-Tracker) |

| مكافحة غسل الأموال.M0007 | تطهير بيانات التدريب | تكامل البيانات: التصديق على البيانات المستخدمة للتدريب والتحقق منها |

| مكافحة غسل الأموال.M0011 | تقييد تحميل المكتبة | سلامة البيانات والكود: التصديق والتحقق من تحميل نموذج البيانات ومكتبة التعليمات البرمجية. |

| مكافحة غسل الأموال.M0013 | توقيع الكود | سلامة الكود: التصديق على الرمز المستخدم والتحقق منه. |

| مكافحة غسل الأموال.M0014 | التحقق من عناصر ML | سلامة البيانات والكود: التصديق والتحقق من تحميل نموذج البيانات ومكتبة التعليمات البرمجية. |

| مكافحة غسل الأموال.M0016 | مسح الثغرات الأمنية | فحص الثغرات الأمنية وتقييم السياسات: تشهد على تنفيذ أدوات مثل فحص الثغرات الأمنية. تقييم السياسات المتعلقة بهذه الشهادات. فحص الثغرات الأمنية بناءً على شهادات SBOM التي تم جمعها من مسار تعلم الآلة. |

التوقيع والتحقق من مجموعات بيانات ونماذج تعلم الآلة باستخدام Valint

Valint هي أداة CLI القوية الخاصة بـ Scribe لإنشاء الشهادات والتحقق من صحتها. يمكن استخدام Valint للتوقيع على مجموعات بيانات ونماذج تعلم الآلة والتحقق منها.

على سبيل المثال:

نريد استخدام نموذج HuggingFace WTP-بيرت-صغيرة. من أجل منع المساس بالنموذج، نريد التوقيع عليه والتحقق منه قبل الاستخدام. يمكن إنشاء شهادة (دليل موقع) باستخدام الأمر التالي:

فالينت بوم جيت:https://huggingface.co/benjamin/wtp-bert-tiny -o يشهد

سيقوم هذا الأمر بإنشاء شهادة موقعة لمستودع النموذج. سيتم تخزين التصديق في مخزن التصديق (في هذه الحالة - مجلد محلي) وسيتم توقيعه (في هذه الحالة - باستخدام التوقيع بدون مفتاح Sigstore).

سيكون الاستخدام النموذجي للنموذج هو استنساخ الريبو واستخدام ملفاته. يمكن التحقق من سلامة النموذج مباشرة بعد التنزيل باستخدام الأوامر التالية:

git clone git:https://huggingface.co/benjamin/wtp-bert-tiny valint تحقق من git:wtp-bert-tiny

يمكن التحقق من سلامة النموذج قبل كل استخدام باستخدام الأمر التالي:

التحقق من valint git:wtp-bert-tiny

ملاحظة:

- ويمكن استخدام نهج مماثل للتوقيع على مجموعات البيانات والتحقق منها.

- إحدى خصائص نماذج ML هي حجمها الضخم. لتجنب تنزيل الملفات الكبيرة غير المطلوبة والتعامل معها، أ أفضل الممارسات هو تنزيل الملفات الضرورية فقط. حالة الاستخدام هذه مدعومة بواسطة Valint، والتي تدعم التوقيع على مجلد أو ملف محدد فقط.

التحقق من السياسات على نماذج تعلم الآلة

Scribe's Valint هي أداة قوية للتحقق من السياسة. إحدى طرق إدارة المخاطر هي تطبيق السياسات. في القسم التالي، سنوضح كيفية تقليل المخاطر من خلال فرض سياسة الترخيص على نماذج تعلم الآلة المستخدمة.

لنفترض أننا نسمح فقط باستخدام ترخيص MIT في مشروعنا. بمجرد تكوينه، يستطيع Valint التحقق منه:

التحقق من valint git:wtp-bert-tiny -d att -c Verified-license.yml

يستخدم هذا الأمر التحقق من الترخيص السياسة التي تم تعريفها على النحو التالي:

تشهد: cocosign: السياسات: - الاسم: تمكين سياسة ML: الوحدات الحقيقية: - الاسم: التحقق من نوع الترخيص: التحقق من تمكين الأداة: الإدخال الحقيقي: التوقيع: التنسيق الحقيقي: attest-cyclonedx-json rego: المسار: التحقق من hf -license.rego

السياسة المطبقة في التحقق من-hf-license.rego يستخرج الملف من الشهادة الموقعة معرف نموذج HuggingFace، ويسحب من معلومات HuggingFace API حول النموذج، ويتحقق من أنه MIT.

ويمكن استخدام تدفق مماثل للتحقق من تراخيص مجموعات البيانات مفتوحة المصدر.

حالة الاستخدام: حماية خدمة Realworld ML-Ops

تعد خدمة ML-Ops جزءًا من تطبيق يتيح الوصول بسهولة إلى نماذج الذكاء الاصطناعي؛ يحتاج مستخدمو الخدمة فقط إلى ذكر طلباتهم، ويتم تنفيذ جميع الإجراءات العملية للوصول إلى نموذج ML خلف الكواليس بواسطة الخدمة.

مثال:

نريد إنتاج واستخدام خدمة تتيح إمكانية الوصول إلى "" Microsoft"توجيه"حزمة مفتوحة المصدر (بكلمات بسيطة، تتيح هذه الحزمة استخدامًا أفضل لنماذج اللغات الكبيرة (LLMs) عن طريق تشغيل سلاسل من الاستعلامات بدلاً من مطالبة واحدة).

ستكون الخدمة عبارة عن صورة Docker تحتوي على رمز الخدمة والنموذج. سنبني الكود الخاص بنا على مشروع سلسلة أندروميدا. يغلف المشروع مكتبة التوجيه بخدمة ويبني صورة عامل إرساء مع التطبيق.

فيما يلي الإصدار الأساسي من ملف Dockerfile:

من بايثون:3.10 نسخة ./requirements.cpu.txt require.txt RUN pip3 install -r Requirements.txt RUN mkdirmodels\cdmodels\git clone https://huggingface.co/api/models/benjamin/wtp-bert- نسخة صغيرة ./guidance_server توجيه_خادم WORKDIR توجيه_server # تعيين نقطة الدخول CMD ["uvicorn"، "main:app"، "--host"، "0.0.0.0"، "--port"، "9000"]

إنه أمر واضح ومباشر. عند إنشاء عامل الإرساء، يتم تثبيت تبعيات التعليمات البرمجية وتثبيت النموذج ونسخ رمز الخدمة إلى صورة Docker.

بمجرد إنشاء الصورة، يمكننا إنشاء شهادة موقعة لها باستخدام أمر Valint التالي:

فالينت بوم مل-سيرفيس:أحدث -o يشهد

ينشئ هذا الأمر شهادة موقعة تحتوي على SBOM تفصيلي لصورة عامل الإرساء المسماة ml-service.

يمكن استخدام هذه الشهادة لاحقًا للتحقق من صورة Docker، باستخدام الأمر التالي:

التحقق من خدمة ML: الأحدث

يتحقق هذا الأمر من سلامة الصورة – كلاً من الكود ونموذج تعلم الآلة. يمكن إجراء التحقق في كل مرة يتم فيها نشر الصورة، وبالتالي ضمان استخدام حاوية صالحة.

إنشاء خدمة ML-Ops محمية

من خلال الجمع بين الإمكانات الموضحة في الفقرات السابقة، يمكننا الآن توضيح كيفية حماية مبنى خدمة ML-Ops:

المتطلب السابق: بمجرد اختيار النموذج – إنشاء تصديق عليه:

فالينت بوم جيت:https://huggingface.co/benjamin/wtp-bert-tiny -o يشهد

بناء خط الأنابيب:

1. تحقق من سلامة النموذج وترخيصه في مسار الإنشاء:

git clone https://huggingface.co/benjamin/wtp-bert-tiny valint التحقق من git:wtp-bert-tiny -d att -c Verified-license.yml

2. قم ببناء عامل الإرساء وإنشاء شهادة له:

docker build -t ml-service:latest . فالينت بوم مل-سيرفيس:أحدث -o يشهد

3. قبل استخدام الصورة، تحقق منها:

التحقق من خدمة ML: الأحدث

تضمن خطوة التحقق هذه أن الصورة المنشورة هي الصورة التي تم إنشاؤها باستخدام النموذج الذي تم التحقق منه بداخله.

يمكن إجراء عملية تحقق مماثلة قبل كل عملية نشر في Kubernetes باستخدام وحدة التحكم في القبول الخاصة بـ Scribe.

توصية مجاناً

يعد الاستثمار في منتج أمان سلسلة توريد البرامج في عام 2024 والذي يعالج المتطلبات المباشرة لسلسلة توريد البرامج والمتطلبات المتطورة لـ MLOps خيارًا استراتيجيًا.

إن الاستثمار في حل قائم على الأدلة مع محرك سياسة مرن من شأنه أن يسمح بالتكامل المستقبلي مع تقنيات أمان MLOps الناشئة الخاصة بالمجال عند نضجها.

لماذا يعد هذا منشورًا على مدونة Scribe Security؟

يجب أن تعرف الإجابة إذا قرأت كل شيء حتى هنا: يوفر Scribe حلاً أمنيًا لسلسلة توريد البرامج قائمًا على الأدلة/الشهادات مع محرك سياسة مرن وقابل للتوسيع. للحصول على حالة استخدام تفصيلية لحماية خط أنابيب MLOps باستخدام منتجات Scribe، اضغط على هنا.

يتم تقديم هذا المحتوى إليك بواسطة Scribe Security، وهي شركة رائدة في مجال توفير حلول أمان سلسلة توريد البرامج الشاملة - حيث توفر أحدث الأمان لعناصر التعليمات البرمجية وعمليات تطوير التعليمات البرمجية وتسليمها عبر سلاسل توريد البرامج. تعرف على المزيد.